- 모빌아이(Mobileye)

- (1) 기업개요 – 1999년 설립된 이스라엘에서 설립된 비전(Vision) 기반의 지능형 운전자 지원 시스템(ADAS) 서비스 제공 회사

- – 2014년 뉴욕 증권거래소에 상장.이스라엘 기업이 추진한 기업공개(IPO) 사례 중 가장 큰 성공을 거두며 유명해졌다. 2017년 인텔이 약 17조6,000억원에 인수. 모빌아이 인수는 인텔 역사상 가장 성공적인 선택지 중 하나로 꼽힌다

- – 핵심기술인 지능형 ADAS는 전방충돌경고(FCW), 보행자충돌경고(PCW), 차로이탈경고(LDW), 지능형헤드라이트제어(IHC), 속도제한표시(SLI) 등을 지원

- – 창업 초기 BMW, GM, 볼보 등 완성차 업체에 주문자상표부착식(OEM)으로 제품을 공급했으나 2007년부터는 애프터마켓에도 진출해 독자적인 브랜드 이미지 구축

- – 과거 테슬라도 모델S에 반자율주행 모드인 오토파일럿(Autopilot) 기능을 구현하기 위해 모빌아이의 비전 중심 컴퓨팅 칩인 ‘EyeQ3’를 채택했지만 오토파일럿에 오류가 발생해 운전자 사망 사건이 발생했다. 이 사건으로 현재 동반자 관계 종료

- – 2019년 ADAS 시장의 상당한 성장에 힘입어 매출액이 10억달러에 육박했고, 최근 2019년 3분기 매출은 전년 동기 대비 20% 이상 성장했다.

<출처:TECHM>

(2) 주요 서비스 – FCW(Forward Collision Warning): 전방 차량 추돌 경보

- HWM & Warning(Headway Monitoring & Warning) : 차간거리 모니터링 및 경보

- – PCW(Pedestrian Collision Warning): 보행자 추돌 경보

- – LDW(Lane Departure Warning): 차로이탈경고

- – SLI(Speed Limit Indication): 제한속도 표지판 인식 및 과속 경보

- – REM(Road Experience Management): EyeQ4 chip, GPS, G-Sensor, 통신모듈 내장 Mobileye8 Connect를 통해 고화질 지도 생성. 아래에 보다 자세한 설명

2. 인텔 모빌아이 CES 2020

- 모빌아이는 CES 2020에서 지금까지 누적 5,400만개 이상 출하된 ‘아이큐(EyeQ)’ 칩을 포함해 인텔에서 가장 빠르게 성장하는 비즈니스인 자율주행 기술을 발표한다.

- – 모빌아이는 현재 레이더와 라이다만 탑재한 방법과 카메라만 탑재한 두 가지 다른 방식으로 자율주행 기술을 개발 중에 있으며,

- – 이날 인텔은 카메라 센서만 장착한 자율주행 자동차가 도로를 주행하는 모습이 담긴 무편집 23분짜리 동영상을 공개했다. 영상에서 차량은 복잡한 교차로, 보행자와 배달 차량 등이 밀집한 환경 등에서도 운행을 성공시킨다.

- – 그 밖에 자율주행을 위한 컴퓨터 비전, 매핑(Mapping), 운전자 지원 시스템(ADAS), MaaS(Mobility-as-a-Service) 관련 기술 및 개념 설명

- – 실적도 빠르게 성장하고 있어 향후 데이터 수익화와 로보택시 등으로 사업을 확대할 것을 발표함

< 출처 : Mobileye >

3) 카메라센서 비전인식

- 모빌아이는 자율주행에 두 가지 각기 다른 방식으로 접근했다. 하나는 카메라만, 다른 하나는 레이더와 라이더만을 사용하여 비전 인식

- – 특히 자율주행을 위한 카메라 트렌드는 전방에만 설치하는 것에서 사방을 감싸듯 변화하고 있다. 그러면서도 비용은 겨우 몇 백달러에 불과하다

- – 카메라만 사용하는 방식의 자율주행차가 센싱 오류가 날 확률은 10,000시간당 1건이 목표다. 이는 매일 2시간 운전한다고 했을 때 10년에 1회꼴

- – 최종적으로는 라이다와 레이더만을 사용하는 방식과 결합해 1,000만 시간당 1건의 오류 확률을 달성할 것으로 기대된다.

< 출처 : Mobileye >

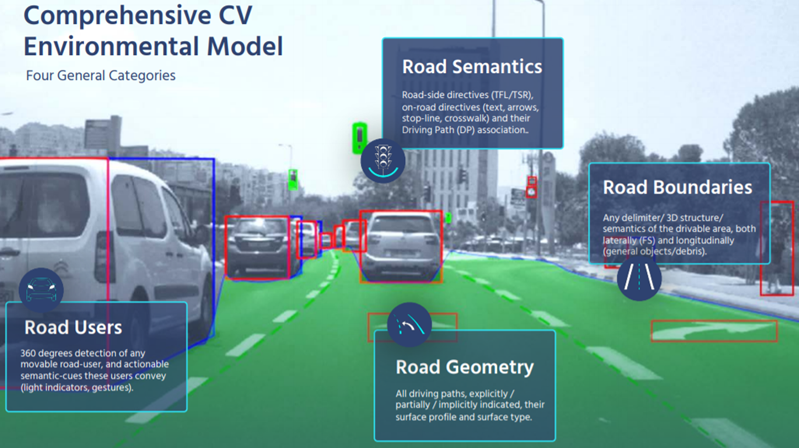

4. 컴퓨터 비전 (Computer Vision)

(1) 카테고리별 분류 1) 로드 사용자(Road Users): 자동차, 보행자, 자전거, 스쿠터 등 도로 위에서 움직일 수 있는 대상 인식. 이들은 정의에 따라 매우 다양하다.

2) 로드 지오메트리(Road Geometry) : 차선뿐만 아니라 도로 표면의 종류와 상태, 각도, 높낮이, 각 차선의 의미 등을 이해

3) 로드 바운더리(Road Boundaries) : 커브, 가드레일 등 주행 가능한 도로 여부 경계 구분

4) 로드 시멘틱(Road Semantics) : 도로 위나 주변의 신호나 표지판 또는 보행자의 움직임, 자동차의 방향지시등등을 인식하고 그 의미를 이해함. 특히 수신호와 같은 보행자의 제스처에 따라 운행이 가능한지 멈출지가 결정되기 때문에 이러한 움직임의 의미를 이해하는 것은 중요하다.

< 출처 : Mobileye >

(2) 기술 구성 1) Detection(감지): 픽셀 단위로 차량 및 사물의 외형(Appearance), 원근감 및 움직임 등을 통해 3차원과 같은 깊이(Geometry) 확인

2) Measurements(측정): 차량을 정확하게 제어하기 위해서는 모든 사물이 3차원으로 위치해야 하므로 카메라를 통해 입력된 2D 이미지를 3D로 변환

3) Internal Redundancy : 위에서 설명한 4가지 카테고리 내에서는 여러 컴퓨터 비전 엔진이 독립적으로 실행된다. 다시 말해 하나의 크고 작은 알고리즘을 사용하는 것이 아니라 서로 영향을 주지 않는 각기 다른 알고리즘을 여러 번 사용하여 감지 및 측정 기능을 구현

< 출처 : Mobileye >

5. 컴퓨터 비전 알고리즘의 종류

(1) 감지 알고리즘 – 예를 들어 아래 이미지의 흰색 버스를 인식하기 위해, 즉 로드 사용자 카테고리에서 감지 기능을 위해 6개의 각기 다른 엔진(알고리즘) 사용

- 3DVD : 전통적인 패턴 인식 방법. 먼저 전체 이미지를 스캔하고 그 중 인식이 필요한 대상을 찾아 박스화해 외형(appearance)을 확인한 후 신경망을 통해 학습. 차문이 열려 있을 때는 그 안에서 갑자기 사람이 밖으로 나올 수 있으므로 차문이 열려 있는 상태나 휠체어, 유모차 등 특별한 경우도 인식할 수 있도록 학습

- 2) Full Image Detection : 저렇게 버스가 가까이 붙어 있어 크게 보이면 같은 외형으로도 박스화하기 어렵기 때문에 다른 방법으로 접근하는 알고리즘

- 3) TopViewFS (Free Space) : 이미지의 녹색 공간은 운전 가능한 공간인 freespace로 운전 불가능한 공간과 구분

- 4) VIDAR : 라이더가 아닌 카메라를 사용한 알고리즘. 사람은 삼각측량을 통해 눈에 들어온 2차원 이미지를 3차원으로 느끼듯 차량을 둘러싼 12대의 카메라(원거리용 8대, 주차용 4대)도 삼각측량을 구현해 3D 이미지를 생성(테슬라와 같은 방식). 그리고 여기서 얻은 이미지 데이터를 라이더 프로세싱 알고리즘에 주입해 인공지능 신경망을 학습한다.

※ 테슬라 비전 인식 방법 참고 *Tesla Automy Day 행사에서 발표한 내용의 토대 1. 테슬라의 인공지능 뉴럴넷(신경망)은 어때… blog.naver.com

5) SceneSegmentation : 보행자, 자동차, 도로, 나무 등 각 대상을 같은 부류별로 구분

6) 6) Wheels

< 출처 : Mobileye >

(2) 측정 알고리즘 1) Map World Model: REM 기술을 통해 HD맵 작성

2) Visual Road Model : HD맵을 활용하여 도로의 형태와 깊이, 각도, 높낮이 등을 구분하여 3차원 정보를 얻는 알고리즘

3) RangeNet : 물건의 외형에 따라 길이 및 폭과 동일한 범위 측정

4) 4) VIDAR

- 이러한 알고리즘을 통해 나온 결과값을 최종적으로 모두 통합하여 자율주행 의사결정

- – 예를 들어 자율주행차가 판단하기에 앞차가 정체된 상황이 주차된 차처럼 장애물이라고 생각해 이를 피해야 하는지, 아니면 교통체증이니 기다리며 천천히 가야 할지 판단하는 것은 매우 헷갈리는 문제다. 이를 해결하기 위해 단순히 앞에 보이는 것이 아니라 다른 알고리즘이 가져온 다양한 정보를 종합하여 어떤 상황인지를 판단

< 출처 : Mobileye >

6. 로보택시&에자일(Agile)

- 모빌아이의 주장은 자율주행 유스케이스가 가장 먼저 로보택시가 될 것이다. 일반인들이 자율주행차를 구매할 수 있게 됐을 때보다 몇 년 앞서 로보택시 비즈니스가 실시될 것으로 예상된다.

- – 이는 말 그대로 비즈니스이기 때문에 인간만큼 주행성능이 좋아야 성공할 수 있다. 따라서 자율주행은 안전뿐만 아니라 남다른 민첩성과 민첩성이 중요함

- – 아래 엘사람에서 시행된 자율주행 영상을 보면 T자형 도로에서 모빌아이 차량은 비보호자 회전을 시도한다. 그러나 차가 멈추지 않자 모빌아이의 차는 왔다갔다를 반복하며 조금씩 전진했다. 결국 틈을 내어 직진차가 오기 전에 커브에 진입해 자회전 성공.

- – 모빌아이는 자율주행차가 이처럼 상황에 맞춰 유연하고 민첩한 주행능력까지 갖춰야 살아남을 수 있다. 설명

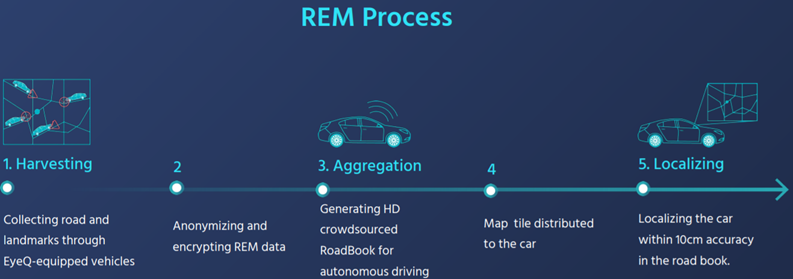

7.REM(Road Experience Management)

- 여러 차량에서 정보를 수집하는 크라우드 소싱을 활용하여 고화질 지도를 생성하는 기술

- – L2+ADAS 탑재 차량이 주행 중 들어온 이미지 중 중요한 정보만 추출해 클라우드 서버로 전송. 서버에서는 인텔 고성능 서버용 CPU의 AI 가속 기능을 활용하고 이를 종합해 고화질 지도를 생성한 후 다시 각 차량에 전송. 킬로미터당 약 10킬로미터에 불과한 초저대역폭 데이터 업로드를 통해 실시간에 가까운 성능 구현. 이 모든 과정은 자동화되어 시간당 45마일의 지도를 생성

- – 최근 16,000회 이상의 주행 데이터를 활용해 라스베이거스 내 400km 이상의 고화질 지도를 생성. 특히 네바다 지역은 도로 지도를 생성하는 데 24시간이 채 걸리지 않는다. 이 지도는 6만 개의 표지판, 2만 개의 신호등 및 가로등과 같은 기둥, 1,500 km 이상의 중앙선을 포함하는 수천 개의 도로 주변의 사물에 대해 센티미터 수준의 정밀도를 제공한다.

- – BMW, NISSAN, 폭스바겐과 이미 2년 전부터 이를 시행했으며 모빌아이는 하루 600만km의 주행 데이터를 받아왔다. 내년 말까지 유럽 전역, 올해 말까지 미국 전역에 대한 도로 지도를 작성할 수 있을 것으로 예상됨

- – 여기에 올해 3개 완성차 업체와 100만대의 차량이 데이터를 보내기로 계약 체결. 이처럼 2022년까지 총 1,400만대의 차량에서 데이터를 받을 것으로 예상된다.

- – 중국 지역도 매핑을 위해 칭화대 유니그룹과 조인트벤처를 설립해 데이터 수집 중이다.중국 전기차 업체 니오(NIO)는 중국 업체 중 모빌아이의 자율주행 시스템을 소비자용 차량에 가장 먼저 탑재한 기업이다.2019년 말 니오로부터 자율주행 Lv4 설계 수주를 받고 2022년 솔루션을 탑재한 차량 출시를 예상한다.

< 출처 : Mobileye >

8. EyeQ 칩

(1) 개요 – 모빌아이의 완전자율주행을 위한 비전중심 컴퓨팅 팁. 카메라 기반 이미지 처리 알고리즘과 ADAS 기능이 이 프로세서 상에서 작동됨

- 두 개의 다이, 즉 두 개의 칩으로 구성되어 있는데, 위에서 설명한 비전 알고리즘은 모두 하나의 칩으로만 처리된다(다른 하나는 컴퓨팅 파워가 부족한 만일의 사태에 대비한 것으로 추측).

- – 전체 칩 사이즈도 90mm 스퀘어로 제온(인텔 서버용 프로세서)과 같은 수백 밀리미터 이상의 다른 제품에 비해 매우 작은 크기

(2) 개발현황 – 2017년 12월 TSMC를 통해 7나노 공정을 도입하여 EyeQ5 제작완료, 2018년 말 정식공개

- 현재 차량당 2개의 EyeQ5 칩에서 2022년에는 6개가 적용될 것으로 예상된다. 사실상 6개까지는 필요 없지만 만일을 대비해 리스크를 막기 위해 충분한 컴퓨팅 파워 탑재

- – 2020년 EyeQ6 샘플 발매 예정. 2023년에는 차량당 단 하나의 EyeQ6칩 탑재

- – 모빌아이는 이 같은 자율주행 시스템 비용을 현재 10,000~15,000달러 수준에서 2025년까지 5,000달러 이하로 낮추는 것이 목표다. 나는 그 정도가 일반 소비자가 지불하기에 합리적인 비용이라고 생각한다

< 출처 : Mobileye >

- 이날 전반적인 발표를 듣고 느낀 점은 테슬라와 마찬가지로 비전 인식 기술 라이다와 같은 고가의 하드웨어를 배제하고 점차 소프트웨어 중심으로 단순화되고 있다는 점. 삼성 갤럭시폰과 달리 구글 픽셀폰이나 애플 아이폰 역시 고가의 카메라 모듈을 넣기보다는 인공지능을 통해 카메라 성능을 향상시키고 있는 것도 마찬가지다.

- – 그리고 또 하나는 자율주행을 위한 비전 기술이 점점 세분화되고 있다는 점이다. 보행자 역시 어떤 보행자, 어떻게 움직이는 보행자, 도로도 미세한 각도에서 높낮이 변화까지 측정하면서 정확도를 더욱 높여 운전 중 발생할 수 있는 모든 위험을 하나씩 제거하고 있다. 이 역시 인공지능 신경망을 주제별로 작게 나누는 소프트웨어적인 방식으로 해결해 나가기 때문에 소프트웨어의 중요성은 점점 커질 것으로 보이며, 이러한 다양한 결과값을 원활하게 통합하여 정확한 의사결정을 지원하는 기술도 중요해질 것으로 보인다.